KI hat die Art und Weise verändert, wie wir Code schreiben. Entwickelnde liefern jetzt schneller, experimentieren mehr und verlassen sich auf KI, um Teile ihres Workflows zu übernehmen, die früher Stunden in Anspruch nahmen.

Doch mit zunehmender Geschwindigkeit steigt auch das Risiko.

Mehr Code bedeutet mehr Möglichkeiten für Schwachstellen, unentdeckt zu bleiben. Und wenn Tests immer noch am Ende des Prozesses stattfinden, ist es bereits zu spät. Hier kommen KI-gestützte SAST-Tools ins Spiel.

Sie helfen Teams, Probleme frühzeitig zu erkennen und zu beheben, um mit der Geschwindigkeit Schritt zu halten, die KI in die Entwicklung bringt.

In diesem Artikel stellen wir die 10 führenden KI-SAST-Tools vor. Wir beleuchten die Kernfunktionen jedes Tools und die einzigartigen Wege, wie sie KI einsetzen, um die Erkennung, Priorisierung und Behebung von Schwachstellen zu verbessern.

Die besten KI-gestützten SAST-Tools auf einen Blick

- Insgesamt am besten / geringe Fehlalarmrate & Auto-Fix:

- Am besten für strenge Datenschutzanforderungen (keine externen KI-Aufrufe):

- Am besten für GitHub-native Workflows:

- Am besten für schnelle IDE-Vorschläge (Schnellkorrekturen):

- Am besten für anpassbare Regeln & Erkennung:

- Am besten für On-Premises / Bring-your-own-LLM:

- Am besten für Enterprise Governance & Legacy-Stacks:

- Bester „AI-first“ Scanning-Ansatz:

- Am besten validierte automatische Behebung im Dashboard:

Was ist SAST?

Statische Anwendungssicherheitstests (SAST) ist eine Methodik zur Analyse des Quellcodes, Bytecodes oder der Binärdateien einer Anwendung, um Schwachstellen und Sicherheitslücken frühzeitig im Software Development Lifecycle (SDLC) zu identifizieren. SAST findet Schwachstellen im Quellcode, was bedeutet, dass es oft die erste Verteidigung gegen unsicheren Code ist.

SAST vs. DAST

Während SAST Code von innen nach außen analysiert, führt DAST (Dynamische Anwendungssicherheitstests) Tests von außen nach innen durch.

Stellen Sie es sich so vor:

- SAST-Tools untersuchen Ihren Quellcode, bevor eine Anwendung ausgeführt wird — und fangen so Probleme wie unsichere Funktionen, hartcodierte Anmeldeinformationen oder Logikfehler während der Entwicklung ab.

- DAST -Tools hingegen führen Sicherheitstests durch, während die Anwendung live ist — und untersuchen sie wie ein Angreifer, um real existierende, ausnutzbare Schwachstellen wie SQL-Injection, XSS oder Authentifizierungs-Bypasses zu finden.

Beide sind essenziell, erfüllen aber unterschiedliche Zwecke im SDLC. Weitere Informationen finden Sie unter SAST vs DAST: Was Sie wissen müssen

Die Vorteile von Statische Anwendungssicherheitstests-Tools

SAST-Tools sind eine der effektivsten Methoden, um Schwachstellen zu finden und zu beheben, bevor Ihr Code überhaupt ausgeführt wird. Hier sind die wichtigsten Vorteile:

- Frühe Erkennung im SDLC: SAST läuft während der Codierung oder Build-Zeit, wodurch Entwickelnde Schwachstellen beheben können, bevor sie die Produktion erreichen. Dieser „Shift-Left“-Ansatz reduziert den gesamten Aufwand, die Kosten und die Zeit für die Behebung.

- Umfassende Code-Abdeckung: Da SAST die gesamte Codebasis, einschließlich Abhängigkeiten und Konfigurationsdateien, untersucht, kann es Fehler identifizieren, die dynamische Tests möglicherweise übersehen würden.

- Entwickelndenfreundliches Feedback: Die besten modernen SAST-Tools integrieren sich in IDEs, Git-Repositorys und CI/CD-Systeme, um In-Line-Feedback, Code-Vorschläge und Auto-Fix-Empfehlungen zu liefern, ohne die Entwicklung zu verlangsamen.

- Unterstützt Compliance und Audit-Bereitschaft: SAST hilft Organisationen, Anforderungen von Frameworks wie SOC 2, ISO 27001, GDPR und OWASP ASVS zu erfüllen, indem nachgewiesen wird, dass sichere Codierungspraktiken etabliert sind.

- Kontinuierliche Verbesserung durch Automatisierung: KI-gestützte SAST-Tools können automatisch aus vergangenen Schwachstellen lernen, Fehlalarme reduzieren und Teams dabei helfen, ihren Code im Laufe der Zeit kontinuierlich zu stärken.

Kurz gesagt, SAST ermöglicht es Entwickelnden, sichere Software von Grund auf zu entwickeln und nicht als nachträglichen Gedanken.

Welche Schwachstellen findet SAST in Ihrem Code?

SAST kann viele verschiedene Schwachstellen finden, und dies hängt von den verwendeten Codierungspraktiken, dem Technologie-Stack und den Frameworks ab. Im Folgenden sind einige der häufigsten Schwachstellen aufgeführt, die ein SAST-Tool typischerweise aufdeckt.

SQL-Injection

Erkennt unsachgemäße Bereinigung von Benutzereingaben, die zu einer Kompromittierung der Datenbank führen könnten.

Beispiel für Python-Code, der anfällig für SQL-Injection ist:

# Function to authenticate user

def authenticate_user(username, password):

query = f"SELECT * FROM users WHERE username = '{user}' AND password = '{password}'"

print(f"Executing query: {query}") # For debugging purposes

cursor.execute(query)

return cursor.fetchone()

Der obige Code ist anfällig, weil die Abfragevariable String-Interpolation (f-string) verwendet und Benutzereingaben direkt über '{username}' einfügt, was es jedem böswilligen Akteur ermöglicht, SQL-Code aus seiner Eingabe in die Datenbank zu injizieren.

Cross-Site-Scripting

Identifiziert Fälle, in denen Benutzereingaben fehlerhaft validiert oder kodiert werden, was die Einschleusung bösartiger Skripte ermöglicht.

Beispiel für clientseitigen JavaScript-Code, der anfällig für XSS ist:

<script>

const params = new URLSearchParams(window.location.search);

const name = params.get('name');

if (name) {

// Directly inserting user input into HTML without sanitization

document.getElementById('greeting').innerHTML = `Hello, ${name}!`;

}

</script>

Der obige Code ist anfällig, weil er .innerHTML verwendet, um Benutzereingaben ohne Sanitization direkt in HTML einzufügen.

Buffer Overflows

Hebt Bereiche hervor, in denen eine unsachgemäße Speicherverwaltung zu Datenkorruption oder Systemabstürzen führen könnte.

Beispiel für C-Code, der anfällig für Buffer Overflow ist:

1#include

2void vulnerableFunction() {

3 char buffer[10]; // A small buffer with space for 10 characters

4

5 printf("Enter some text: ");

6 gets(buffer); // Dangerous function: does not check input size

7

8 printf("You entered: %s\n", buffer);

9}

10

11int main() {

12 vulnerableFunction();

13 return 0;

14}

Der obige Code ist anfällig, weil er die gefährliche gets()-C-Funktion verwendet. Die gets()-Funktion kennt die Größe des Puffers nicht, in den sie liest, was dazu führen kann, dass mehr Daten gelesen werden, als der Puffer aufnehmen kann, was zu einem Buffer Overflow führt.

Unsichere kryptografische Praktiken

Erkennt schwache Verschlüsselungsalgorithmen, unsachgemäßes Schlüsselmanagement oder hartcodierte Schlüssel.

Beispiel für anfälligen Python-Kryptographie-Code, der die veraltete MD5-Hash-Funktion:

import hashlib

def store_password(password):

# Weak hashing algorithm (MD5 is broken and unsuitable for passwords)

hashed_password = hashlib.md5(password.encode()).hexdigest()

print(f"Storing hashed password: {hashed_password}")

return hashed_password

Insgesamt bieten SAST-Tools wertvolle Einblicke, die es Entwickelnden ermöglichen, Probleme zu beheben, bevor sie kritisch werden.

Wie Statische Anwendungssicherheitstests (SAST) funktionieren

Sie haben gelernt, was SAST ist und welche Arten von Schwachstellen es findet; nun wollen wir sehen, wie es hinter den Kulissen funktioniert.

Der SAST-Prozess folgt typischerweise diesen vier Kernschritten:

Schritt 1: Code-Parsing und -Modellierung

Das Tool scannt den Quellcode, Bytecode oder die Binärdateien der Anwendung, um eine strukturierte Darstellung (einen abstrakten Syntaxbaum oder Datenflussgraphen) zu erstellen. Dies hilft zu verstehen, wie der Code aufgebaut ist, wie Daten durch ihn fließen und wo Sicherheitskontrollen vorhanden sein sollten.

Schritt 2: Regelbasierte Analyse

Als Nächstes wendet das Tool eine Reihe von Sicherheitsregeln und -mustern an, um riskante Code-Konstrukte zu identifizieren.

Schritt 3: Korrelation und Priorisierung von Schwachstellen

Nicht jede Erkenntnis ist kritisch. SAST-Tools analysieren den Kontext:

- wo die Schwachstelle existiert,

- wie sie ausgenutzt werden könnte, und

- ob sie sensible Daten betrifft

Um Fehlalarme zu reduzieren und hervorzuheben, was wirklich wichtig ist.

Schritt 4: Berichterstattung und Feedback von Entwickelnden

Schließlich werden die Ergebnisse sichtbar. Entwickelnde können sofort darauf reagieren, wodurch Sicherheit in den täglichen Workflow integriert bleibt, anstatt als separate Phase behandelt zu werden.

All diese Schritte werden heute durch KI auf die nächste Stufe gehoben.

Wie KI SAST-Tools verbessert

Aktuell kommt man am KI-Hype (und Unsinn) nicht vorbei. Es kann schwierig sein, genau zu wissen, wie KI in Sicherheitstools implementiert wird.

Aktuell gibt es drei Trends im Zusammenhang mit KI und SAST-Tools:

- KI zur Verbesserung der Schwachstellen-Erkennung: KI-Modelle, die auf großen Datensätzen bekannter Schwachstellen trainiert wurden, verbessern die Genauigkeit bei der Identifizierung von Sicherheitsproblemen und reduzieren gleichzeitig Fehlalarme.

- KI zur automatisierten Priorisierung: KI hilft, Schwachstellen basierend auf Schweregrad, Ausnutzbarkeit und potenziellem Geschäftsrisiko zu bewerten, wodurch sich Entwickelnde zuerst auf kritische Probleme konzentrieren können.

- KI zur Bereitstellung automatischer Behebung: KI liefert kontextsensitive Code-Korrekturen oder -Vorschläge, was den Behebungsprozess beschleunigt und Entwickelnden hilft, sichere Codierungspraktiken zu erlernen.

Als Nächstes werden wir einige der führenden Anbieter im Bereich KI-gestützter SAST-Tools vergleichen und die verschiedenen Wege erläutern, wie diese Tools KI zur Verbesserung der Sicherheit implementieren.

Die 10 besten KI-gestützten SAST-Tools

Hier sind 10 Branchenführer, die KI auf unterschiedliche Weise nutzen, um die Fähigkeiten traditioneller SAST zu erweitern (In alphabetischer Reihenfolge)

TL;DR:

Aikido nimmt den ersten Platz als SAST-Lösung ein, die über das reine Code-Scanning hinausgeht. Für kleine bis mittlere Unternehmen erhalten Sie alles, was Sie zur Sicherung Ihrer IT-Infrastruktur benötigen, in einer Suite. Für Großunternehmen bietet Aikido SAST zusammen mit erstklassigen Sicherheitsprodukten an, sodass Sie das benötigte Modul auswählen und die Plattform freischalten können, wenn Sie bereit sind.

Es nutzt KI, um Schwachstellen automatisch zu beheben und filtert das Rauschen heraus (wenige Fehlalarme), sodass Entwicklerteams nur echte Probleme sehen. Aikido ist die pragmatische Wahl für CISOs, CTOs und Entwickelnde, die schnelle, intelligente Codesicherheit wünschen.

1. Aikido Security SAST | KI-AutoFix

KI-Kernfunktion | Automatische Behebung (Dashboard + IDE)

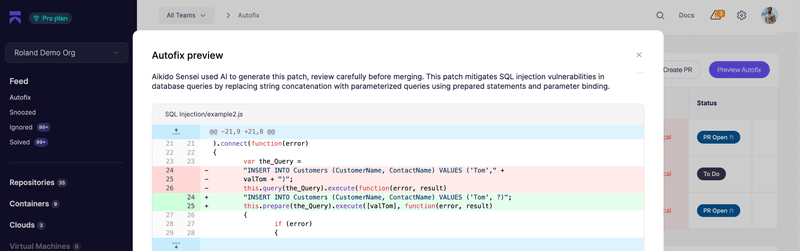

Aikido Security nutzt KI, um Code-Korrekturen für Schwachstellen zu erstellen, die von seinem SAST-Scanner entdeckt wurden, und kann sogar automatisierte Pull-Requests generieren, um den Behebungsprozess zu beschleunigen.

Im Gegensatz zu anderen Tools sendet Aikido Ihren Code nicht an ein Drittanbieter-KI-Modell, speichert oder verwendet ihn niemals zum Trainieren von KI, läuft vollständig auf lokalen Servern und verfügt über eine einzigartige Methode, um sicherzustellen, dass Ihr Code nicht über KI-Modelle nach außen gelangt.

Aikido wendet zunächst eigene Sicherheitsregeln an, um Fehlalarme herauszufiltern, und nutzt dann ein speziell abgestimmtes LLM ausschließlich zur Verifizierung und Verfeinerung von Vorschlägen. Die gesamte Analyse erfolgt in einer sicheren Sandbox, sodass, sobald die vorgeschlagene Behebung die Validierung bestanden hat, ein Pull-Request automatisch erstellt werden kann, bevor die Sandbox-Umgebung zerstört wird.

Aikidos KI-AutoFix bietet auch Konfidenzwerte, die ohne Lernen aus Ihrem Code berechnet werden, damit Entwickelnde fundierte Entscheidungen treffen können.

Wichtige Funktionen:

- Geringe Fehlalarmrate / Rauschreduzierung: Aikido legt Wert auf Ergebnisse mit hoher Konfidenz, indem es nicht-sicherheitsrelevante Warnungen und „Wolfsruf“-Meldungen herausfiltert und verwendet eine KI-basierte Triage-Engine, um Fehlalarme zu reduzieren (bis zu ~95 % Reduzierung).

- IDE- & Pull-Request- / CI/CD-Integration: Aikido SAST-Prüfungen integrieren sich direkt in die Workflows von Entwickelnden, mit Inline-Feedback in IDEs und PR-Kommentaren sowie Gating in CI/CD-Pipelines.

- KI-gestützte automatische Korrektur / Behebungsvorschläge: Für viele Schwachstellen kann Aikido KI-AutoFix automatisch Korrekturen oder Patches generieren (oder vorschlagen), um die Behebung zu beschleunigen.

- Kontextsensitive Schweregradbewertung & Benutzerdefinierte Regeln: Probleme werden basierend auf dem Kontext priorisiert (z. B. ob ein Repository öffentlich ist oder sensible Daten verarbeitet), und Benutzer können Benutzerdefinierte Regeln definieren, die auf ihre Codebasis zugeschnitten sind.

- Multi-Datei Taint-Tracking & breite Sprachunterstützung: Es führt dateiübergreifende Analysen durch (Verfolgung kontaminierter Eingaben über Module hinweg), unterstützt viele gängige Sprachen sofort einsatzbereit und erfordert keine Kompilierung.

- Und mehr.

Am besten geeignet für: CISOs, die sich der Bedürfnisse von Entwickelnde bewusst sind, aus großen Unternehmen, Startups und Scale-ups.

Vorteile:

- Entwickelt für Entwickelnde mit Fokus auf die Reduzierung der kognitiven Belastung im Bereich Sicherheit über den gesamten SDLC hinweg

- Nutzt KI für Code-Korrekturen.

- Generiert automatisierte Pull Requests.

- Gewährleistet Code-Privatsphäre, indem er nicht an Drittanbieter-KI-Modelle gesendet wird.

- Vereinheitlichte Plattform, die mehrere Sicherheitsebenen abdeckt (SAST, SCA, IaC, Secrets, Runtime, Cloud), sodass Sie nicht viele separate Tools zusammenstückeln müssen

- Einfache Einrichtung und Integration in bestehende Entwickelnde-Workflows

- Transparente Preisgestaltung und gutes Preis-Leistungs-Verhältnis ohne versteckte Kosten

Nachteile:

Keine vermerkt.

2. Checkmarx

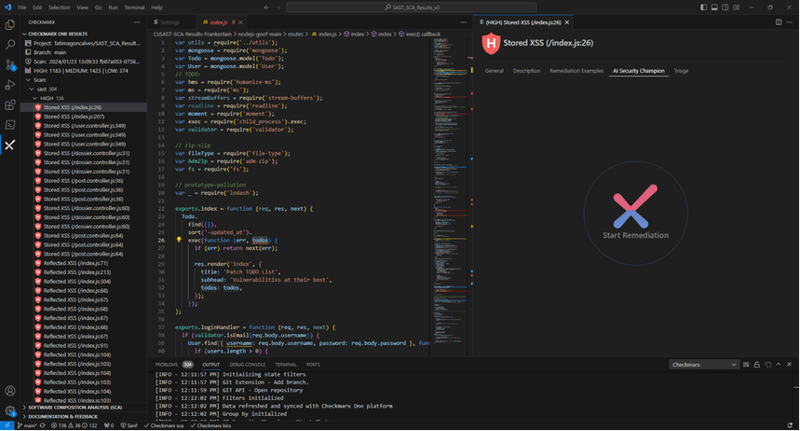

Kern-AI-Funktion | Auto-Remediation (nur IDE)

Checkmarx SAST-Tools können KI-generierte Code-Vorschläge für Entwickelnde in ihrer IDE bereitstellen. Das Tool verbindet sich mit ChatGPT, überträgt den Code der Entwickelnde an das OpenAI-Modell und ruft die Vorschläge ab. Diese Methode erleichtert den Prozess der Abfrage von ChatGPT, fügt aber keine proprietären Prozesse hinzu, was ihm derzeit begrenzte Fähigkeiten verleiht.

WARNUNG:Dieser Anwendungsfall sendet Ihren proprietären Code an OpenAI und erfüllt möglicherweise nicht die Compliance-Standards.

Wichtige Funktionen:

- Unterstützung mehrerer Sprachen: Fähig, eine breite Palette von Programmiersprachen, einschließlich Java, JavaScript und Python, mit tiefer analytischer Abdeckung zu scannen.

- Hochgradig skalierbar: Entwickelt, um große und komplexe Projekte effizient zu verwalten, ohne Kompromisse bei Geschwindigkeit oder Genauigkeit einzugehen.

- Nahtlose CI/CD-Integration: Integriert sich reibungslos in CI/CD-Pipelines, wodurch Teams Schwachstellen frühzeitig im Entwicklungszyklus erkennen können.

Am besten geeignet für: Organisationen, die bereit sind, das Risiko zu akzeptieren (oder zu managen), proprietäre Code-Snippets an externe KI-Dienste (wie ChatGPT) für Vorschläge zur Behebung zu senden.

Vorteile:

- Bietet KI-generierte Code-Vorschläge in IDEs durch die Verbindung mit ChatGPT.

- Gutes Ökosystem von Integrationen (IDE, CI/CD, SCM), was die Akzeptanz durch Entwickelnde erleichtert.

- Echtzeit-IDE-Scanning und ASCA (AI Secure Coding Assistant) bieten sofortiges Feedback (wenn auch begrenzt), um Probleme frühzeitig zu erkennen.

Nachteile:

- Sendet proprietären Code an OpenAI, was möglicherweise nicht den Compliance-Standards entspricht.

- Komplexität / Lernkurve kann für neue Benutzer oder kleine Teams, denen es an ausgeprägter AppSec-Reife mangelt, hoch sein

- Kosten/Lizenzierung können eine Barriere darstellen; es ist oft im Premium-Segment angesiedelt, was für kleinere Organisationen schwer zu rechtfertigen sein könnte

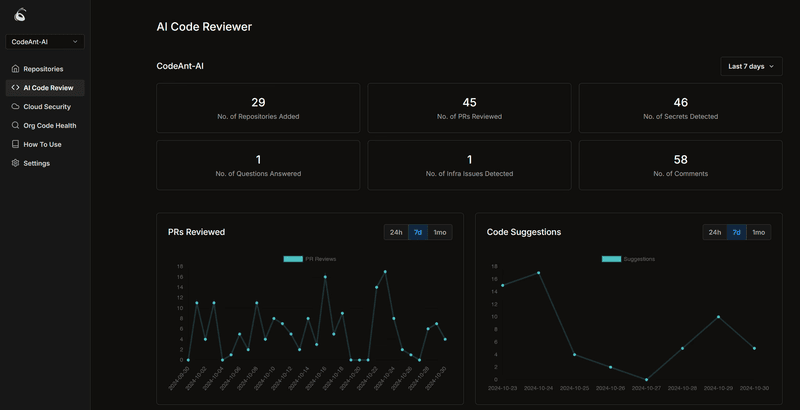

3. CodeAnt AI

Kern-AI-Funktion | Verbesserte Erkennung (Dashboard)

CodeAnt ist ein Tool für Codesicherheit und -qualität, das vollständig KI für die Erkennung von Code-Schwachstellen und vorgeschlagene Korrekturen nutzt. CodeAnt stellt keine Dokumentation darüber bereit, wie ihre KI-Modelle funktionieren, nutzt aber im Allgemeinen KI als ihren zentralen Erkennungs-Engine, was die Erkennung verlangsamen kann, insbesondere in großen Unternehmen.

Wichtige Funktionen:

- KI-gesteuerter SAST / Sicherheitsscanning: Wird bei Pull Requests ausgelöst, um Schwachstellen und Bugs zu erkennen.

- Code-Gesundheits- & Qualitätsanalyse: Umfasst Code Smells, Duplizierungen und Komplexitätsprüfungen neben Sicherheitsscans.

- Git-Plattform-Integration: Funktioniert mit GitHub, Bitbucket, GitLab und Azure DevOps.

Am besten geeignet für: Teams, die Geschwindigkeit und Automatisierung bei Code-Reviews und Sicherheit priorisieren und einen Großteil des manuellen Überprüfungsaufwands auslagern möchten.

Vorteile:

- Hochgradig automatisiert und KI-zentriert, was die Erkennung, Code-Reviews und Behebungsarbeiten beschleunigen kann

- Vereinheitlichter Toolset, der Sicherheit, Code-Qualität, Secrets, SCA, IaC auf einer Plattform umfasst

- Integration in Entwicklungsworkflows (PRs, CI Gating, Dashboards) → weniger Kontextwechsel

Nachteile:

- Begrenzte Integrationen im Vergleich zu anderen Tools

- Mangelnde Transparenz darüber, wie die KI-Modelle intern funktionieren

- Die Performance kann sich bei sehr großen Repositorys oder Codebasen im Unternehmensmaßstab verschlechtern / verzögern

- Schwierigkeiten beim Tuning oder Anpassen von Regeln über das hinaus, was die KI bietet (in mancher Hinsicht weniger Kontrolle als klassisches SAST)

- Der „Black-Box“-Charakter könnte das Vertrauen der Entwickelnden mindern oder das Debugging von False Positives erschweren

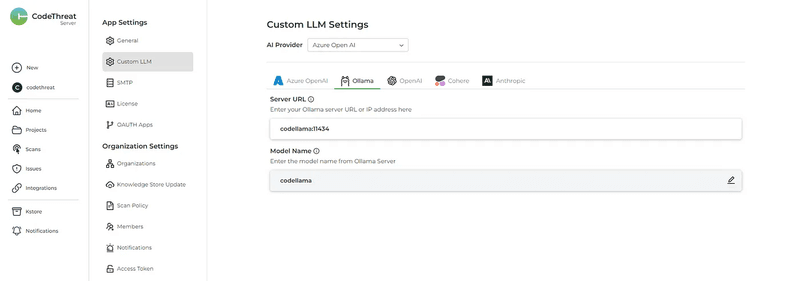

4. CodeThreat

Kern-AI-Funktion | Automatisierte Priorisierung (Dashboard)

CodeThreat bietet on-premise statische Codeanalyse und stellt KI-gestützte Behebungsstrategien bereit. Ein wesentlicher Unterschied ist, dass CodeThreat die Integration eines eigenen on-premise KI-Modells in ihr Tool ermöglicht. Dies hat den Vorteil, dass keine Daten an Dritte gesendet werden, bedeutet aber, dass es derzeit nur generisch trainierte KI-Modelle anbieten kann und Sie ein on-premise KI-LLM wie ChatGPT betreiben müssen.

Wichtige Funktionen:

- On-premise statische Codeanalyse: Führt Scans lokal aus, ohne Code an externe Cloud-Systeme zu senden.

- KI-gestützte Behebung: Bietet automatisierte Korrekturvorschläge basierend auf internen Modellen.

- VS Code Plugin-Unterstützung: Ermöglicht Entwickelnden, Scans auszulösen und Korrekturvorschläge direkt in ihrer IDE anzuzeigen.

Am besten geeignet für: Organisationen mit strengen Anforderungen an Datensouveränität / Compliance, die nicht zulassen können, dass Code die eigenen Räumlichkeiten verlässt.

Vorteile:

- Datenkontrolle & Datenschutz: Da Sie KI-Modelle intern ausführen können, vermeiden Sie das Senden sensiblen Codes an Dritte.

- Flexibilität / Anpassbarkeit: Die Möglichkeit, Ihr eigenes Modell zu integrieren, gibt Ihnen Kontrolle über das Inferenzverhalten oder die Abstimmung.

- Lokale Performance (potenziell): Bei internen Modellen können Latenz und Durchsatz ohne Abhängigkeit von API-Aufrufen optimiert werden

Nachteile:

- Wenn Ihr on-prem Modell eine geringere Kapazität hat oder es an Domänentraining mangelt, können False Positives / False Negatives schlechter ausfallen

- Beschränkt auf generisch trainierte KI-Modelle;

- Erfordert den Betrieb eines on-premise KI-LLM wie ChatGPT.

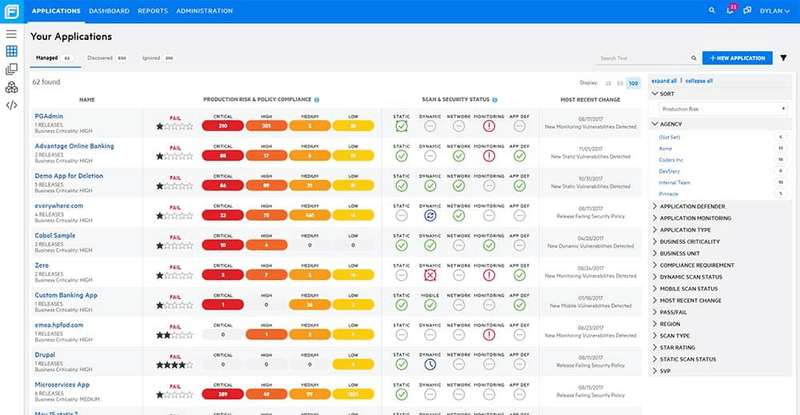

5. OpenText™ Statische Anwendungssicherheitstests (SAST)

KI-Kernfunktion | Verbesserte Priorisierung (Dashboard)

OpenText™ Statische Anwendungssicherheitstests (Fortify) scannt Quellcode auf Schwachstellen und bietet Benutzern die Möglichkeit, Schwellenwerte anzupassen, wenn eine Warnung ausgelöst wird. Zum Beispiel die Wahrscheinlichkeit der Ausnutzbarkeit. Der AI Auto-Assistent von Fortify überprüft die zuvor zugewiesenen Schwellenwerte für Schwachstellen und trifft intelligente Vorhersagen darüber, wie die Schwellenwerte für andere Schwachstellen sein sollten.

Hinweis: Fortify Static Code Analyzer verwendet keine KI, um Schwachstellen zu entdecken oder Korrekturen dafür vorzuschlagen, sondern nutzt sie, um administrative Einstellungen in den Admin-Panels vorherzusagen.

Wichtige Funktionen:

- Unterstützung mehrerer Sprachen: Unterstützt über 33 Programmiersprachen und Frameworks, indem Code- (oder Bytecode-)Pfade analysiert werden, um Schwachstellen zu erkennen.

- IDE-, Build-Tool- und CI/CD-Integrationen: Ermöglicht Scans frühzeitig in Pull Requests und Builds auszuführen.

- Flexible Bereitstellung: Unterstützt on-premise, private Cloud, Hybrid- oder gehostete Optionen

Am besten geeignet für: Teams, die bereits OpenText-Lösungen in ihre Systeme integriert haben.

Vorteile:

- Robuste, ausgereifte statische Analyse-Engine mit breiter Sprach- und Framework-Unterstützung

- Umfangreiche Anpassungsoptionen (Richtlinien, Schwellenwerte, Taint-Flags, Regeln) zur Anpassung von Rauschunterdrückung und Präzision

- Zentrale Governance, Audit-Tracking, Dashboards, Integration mit Ticketing- und DevSecOps-Tools

- Starker Ruf, Präsenz im Unternehmensmarkt, nachgewiesene Erfolgsbilanz

Nachteile:

- Die KI-Komponente ist begrenzt. Sie generiert oder schlägt keinen Korrekturcode vor, sondern hilft nur bei der Klassifizierung / den Schwellenwerteinstellungen

- Der Aufwand für Einrichtung, Feinabstimmung und Konfiguration kann erheblich sein (insbesondere bei großen, vielfältigen Codebasen)

- Die Komplexität und die Lizenzkosten können relativ hoch sein. Die Preisgestaltung ist zudem nicht öffentlich verfügbar und erfordert direkten Kontakt mit dem Vertriebsteam für ein Angebot.

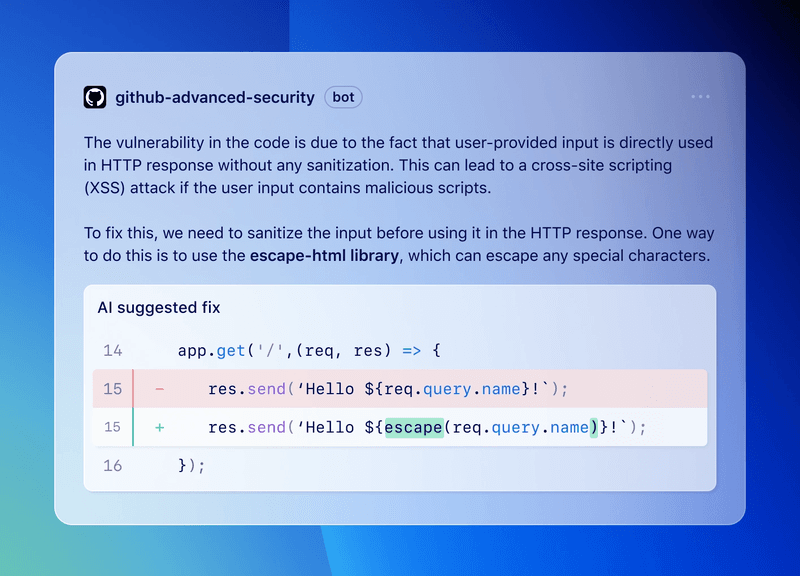

6. GitHub Advanced Security | CodeQL

Kern-AI-Funktion | Auto-Remediation (IDE + Dashboard)

GitHub CodeQL ist ein statischer Code-Scanner, der KI nutzt, um intelligente automatische Korrekturen in Form von Code-Vorschlägen zu erstellen. Entwickelnde können die Änderungen über Pull Requests in GitHub CodeSpaces oder von ihrem Rechner aus annehmen oder ablehnen. Es ist Teil von GitHub Advanced Security.

Wichtige Funktionen:

- Copilot AutoFix / KI-gestützte Vorschläge: Für unterstützte Warnungen generiert die KI Codeänderungen (mit Erklärungen), die sich über mehrere Dateien und Abhängigkeitsänderungen erstrecken können.

- Unterstützung für mehrere Sprachen: Sowohl für Scans als auch für AutoFix-Vorschläge

- Konfigurierbares / Opt-out-Verhalten: Sie können AutoFix deaktivieren oder über Richtlinien anpassen.

Am besten geeignet für: Entwicklungsteams, die bereits GitHub / GitHub Advanced Security nutzen und eine nahtlose Integration von Sicherheit und Behebung in ihren Workflow wünschen.

Vorteile:

- Sie benötigen kein Abonnement für GitHub Copilot, um GitHub Copilot AutoFix zu nutzen.

- Vereint Sicherheit und Entwicklung auf einer Plattform (GitHub), was in vielen Fällen weniger Bedarf an externen SAST-Tools bedeutet.

- Reibungslose Entwickelnden-Erfahrung: Vorschläge erscheinen in derselben PR-Ansicht, wodurch der Kontextwechsel minimiert wird.

Nachteile:

- Größe der Code-Datei: Wenn der betroffene Code in einer sehr großen Datei oder einem Repository liegt, kann der dem LLM bereitgestellte Kontext abgeschnitten werden.

- Begrenzte Abdeckung: Obwohl Copilot AutoFix eine wachsende Liste von Sprachen und CodeQL-Warnungen unterstützt, deckt es nicht jeden möglichen Warnungstyp oder jede Sprache ab.

- In komplexen Codebasen berücksichtigen Vorschläge möglicherweise nicht alle Interdependenzen, Nebenwirkungen oder architektonischen Einschränkungen

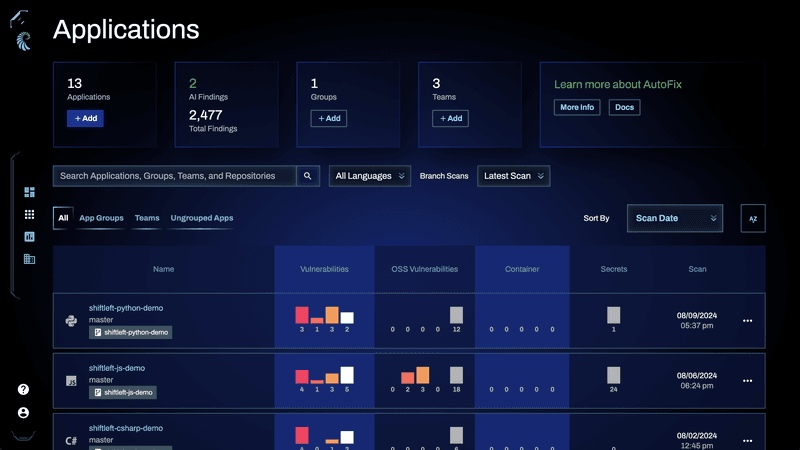

7. Qwiet AI | SAST Code

KI-Kernfunktion | Automatische Behebung (Dashboard)

Qwiet AI SAST ist ein regelbasiertes Tool für Statische Anwendungssicherheitstests, das KI nutzt, um automatisch Korrekturhinweise und Code-Fixes für Code-Schwachstellen vorzuschlagen. Sein Kernangebot sind seine dreistufigen KI-Agenten, die das Problem analysieren, eine Lösung vorschlagen und diese dann validieren.

Wichtige Funktionen:

- Schnelles Scannen im großen Maßstab: behauptet, Millionen von Zeilen in Minuten zu scannen, mit dem Ziel, die Leistung gegenüber älteren SAST-Tools zu verbessern.

- KI-Vorschläge zur Behebung: Für viele Findings bietet Qwiet kontextbezogene Code-Vorschläge (und validiert diese), um den manuellen Korrekturaufwand zu reduzieren.

- Vereinheitlichte Scan-Abdeckung: umfasst die Erkennung von Code, Containern, Secrets und Abhängigkeiten (SCA) auf derselben Plattform.

Am besten geeignet für: Teams, die automatische Behebung priorisieren.

Vorteile:

- Verwendet einen dreistufigen KI-Agentenprozess.

- Benutzer schätzen die umfassende Dokumentation und den reaktionsschnellen Support von Qwiet AI, was eine nahtlose Integration in CI/CD-Pipelines ermöglicht.

Nachteile:

- Es ist ein relativ neues / neueres Tool, daher könnten Reife, Ökosystem-Support und langfristige Stabilität unsicher sein

- Benutzer empfinden die begrenzten Anpassungsmöglichkeiten als frustrierend, da Benutzerdefinierte Richtlinien nur über die CLI festgelegt werden können.

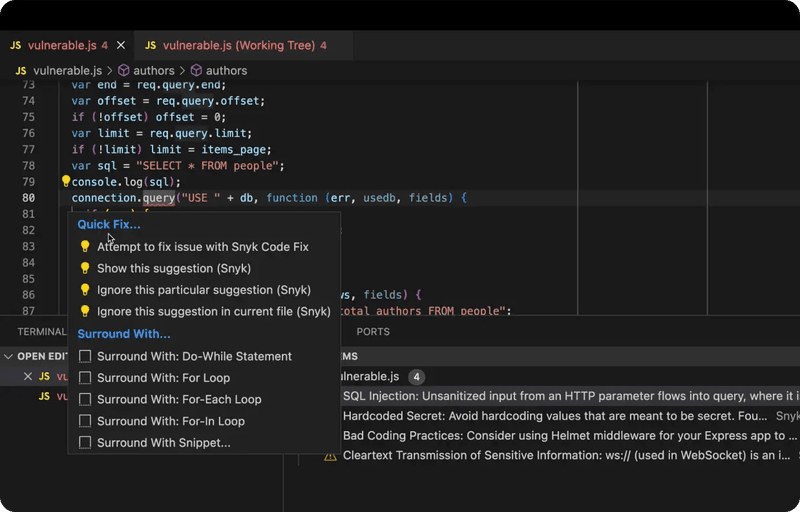

8. Snyk Code | DeepCode

Kern-AI-Funktion | Auto-Remediation (IDE)

Snyk Code ist ein SAST-Tool, das Entwickelnden dank DeepCode AI (jetzt Snyk Agent Fix), das Snyk übernommen hat, Code-Vorschläge direkt in der IDE bereitstellen kann. DeepCode AI nutzt mehrere KI-Modelle, aber Snyks proprietäre Regeln schränken Transparenz und Anpassung ein (obwohl es Benutzerdefinierte Regeln zulässt). Snyks kommerzielle Stufe kann für Organisationen kostspielig sein, die eine Abdeckung über verschiedene Pipelines und Entwickelnden-Teams hinweg benötigen.

Wichtige Funktionen:

- Echtzeit-Scanning in IDE / Entwickelnden-Workflow: Schwachstellen werden während des Codierens markiert und in IDEs, PRs und CI/CD integriert.

- Vorschläge zur Behebung: Für viele unterstützte Findings kann Snyk potenzielle Korrektur-Snippets generieren, die Entwickelnde akzeptieren, bearbeiten oder ablehnen können.

- Erstellung Benutzerdefinierter Regeln / Abfragen: Benutzer können Benutzerdefinierte Regeln / Abfragen mithilfe der DeepCode-Logik (mit Autovervollständigung) erstellen, um das Scanning an ihre Codebasis anzupassen.

Am besten geeignet für: Entwickelnden-Teams, die bereits Snyk / die Snyk-Plattform (SCA, IaC usw.) nutzen und integriertes Code-Scanning wünschen.

Vorteile:

- Bietet Code-Vorschläge für Entwickelnde innerhalb von IDEs.

- Nutzt mehrere KI-Modelle, die mit Daten trainiert wurden, die von führenden Sicherheitsspezialisten kuratiert wurden.

Nachteile:

- Begrenzte Transparenz und Anpassung in seiner KI- / Behebungs-Engine.

- Kosten-Skalierung / Lizenzierungsfragen: Viele Benutzer berichten, dass Snyk bei Skalierung teuer wird (insbesondere bei der Abdeckung mehrerer Entwickelnden-Teams / Pipelines).

- Snyk Agent Fix unterstützt derzeit keine dateiübergreifenden Korrekturen.

- Begrenzte Unterstützung für wichtige Programmiersprachen wie Go, C#, C/C++ usw.

- Einige Bewertungen erwähnen Bedenken hinsichtlich der UI- oder Tool-Performance, gelegentliche Ausfälle oder Langsamkeit bei den Kern-Engine-Operationen.

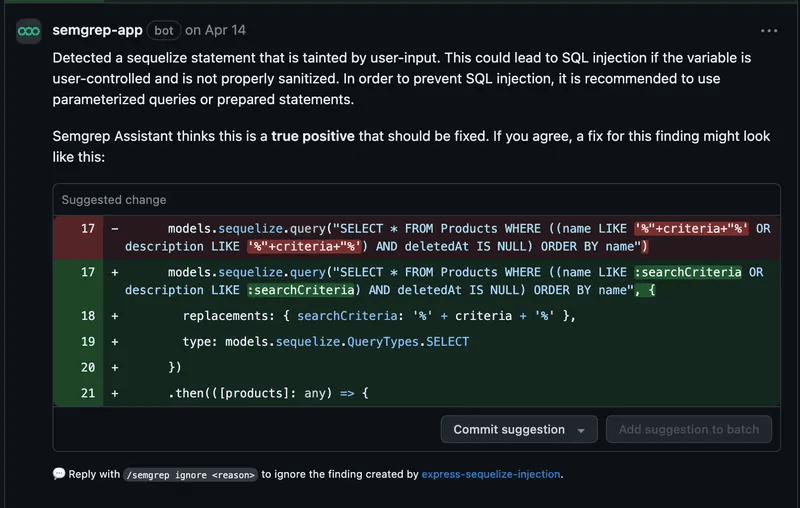

9. Semgrep Code

KI-Kernfunktion | Verbesserte Erkennung

Semgreps KI-Assistent, passenderweise Assistent genannt, nutzt den Kontext des Codes um eine potenzielle Schwachstelle herum, um genauere Ergebnisse und empfohlene Code-Korrekturen zu liefern. Er kann auch verwendet werden, um Regeln für Semgrep zu erstellen, um dessen Erkennung basierend auf den von Ihnen bereitgestellten Prompts zu verbessern.

Wichtige Funktionen:

- Kontextlernen mit „Memories“: Der Assistent kann sich an frühere Triage-Entscheidungen oder den organisatorischen Kontext erinnern, damit ähnliche zukünftige Findings intelligenter triagiert werden.

- Komponenten-Tagging & Priorisierung: Der Assistant kann Befunde nach Kontext (z. B. Authentifizierung, Zahlungen) taggen, um die Priorisierung von Bereichen mit höherem Risiko zu unterstützen.

- Anleitung zur Behebung: Für viele True-Positive-Befunde bietet der Assistant Schritt-für-Schritt-Anleitungen in natürlicher Sprache + Code-Snippets, um den anfälligen Code zu beheben oder zu verbessern.

Ideal für: Teams, die bereits im Semgrep-Ökosystem sind und die Produktivität der Entwickelnden und die Triage-Effizienz verbessern möchten.

Vorteile:

- Nutzt KI, um präzise Ergebnisse und empfohlene Code-Korrekturen zu liefern;

- Kann Regeln basierend auf Prompts erstellen.

Nachteile:

- “Memories” Komplexität: Das Management dessen, was der Assistant „sich merkt“ (Triage-Logik, vertrauenswürdige Quellen), kann zu kognitivem Mehraufwand führen und birgt das Risiko einer Abweichung bei Fehlkonfiguration.

- Standardmäßig verwendet Semgrep Assistant OpenAI und AWS Bedrock mit den API-Schlüsseln von Semgrep. Bedenken hinsichtlich Datenschutz, Compliance oder Kosten können entstehen (obwohl Semgrep Optionen und Speichersteuerungen bietet).

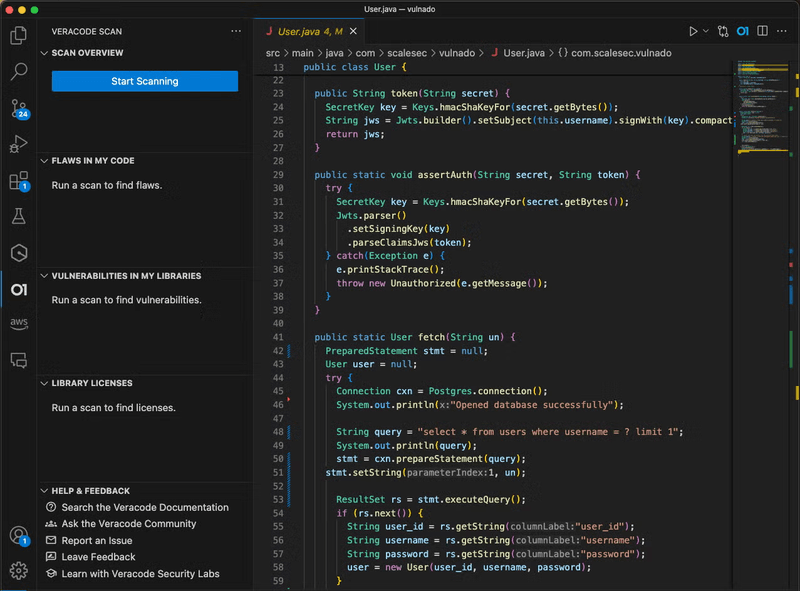

10. Veracode Fix

KI-Kernfunktion | Automatische Behebung

Veracode Fix nutzt KI, um Änderungen basierend auf Schwachstellen im Code vorzuschlagen, wenn Entwickelnde die Veracode IDE-Erweiterung oder das CLI-Tool verwenden. Das Hauptunterscheidungsmerkmal von Veracode Fix ist, dass ihr speziell trainiertes Modell nicht auf Code „in the wild“, sondern auf bekannten Schwachstellen in ihrer Datenbank trainiert wird. Der Vorteil davon ist ein höheres Vertrauen in vorgeschlagene Korrekturen, der Nachteil ist, dass es in den Szenarien, in denen es Code-Korrekturen vorschlagen kann, begrenzter ist.

Wichtige Funktionen:

- „Batch-Fix“-Modus: Möglichkeit, die am besten bewerteten Korrekturen in einem Vorgang auf mehrere Befunde oder Dateien in einem Verzeichnis anzuwenden.

- Integration in das Veracode-Produktökosystem: Fix ist Teil des Veracode-Stacks für IDE-Scanning, -Analyse und -Reporting.

- CI/CD-Integration: Integriert sich nahtlos in CI/CD-Pipelines, ermöglicht kontinuierliches Testen und liefert umgehendes Feedback.

Ideal für: Unternehmen, die das Veracode-Ökosystem nutzen und zuverlässige, verifizierte KI-gestützte Korrekturen wünschen, ohne Code Drittanbieter-Modellen auszusetzen.

Vorteile:

- Die Integration mit Veracode-Scanning und -Reporting bedeutet, dass die Korrekturen mit bestehenden Workflows und Scans übereinstimmen werden.

- Die eingeschränkte Natur des Modells reduziert die Wahrscheinlichkeit von unkontrollierten oder unsicheren Vorschlägen außerhalb bekannter Muster.

Nachteile:

- Begrenzt in den Szenarien, in denen es Code-Fixes vorschlagen kann, da es auf bekannten Schwachstellen trainiert ist.

- Risiko der übermäßigen Abhängigkeit: Entwickelnde könnten Vorschlägen zu sehr vertrauen, ohne sorgfältige Überprüfung, insbesondere in subtilen oder komplexen Teilen des Codes.

Wie man ein SAST-Tool auswählt

KI ist ein relativ neuer Akteur auf dem Sicherheitsmarkt, und Branchenführer erforschen kontinuierlich innovative Anwendungen. KI sollte als Werkzeug zur Verbesserung von Sicherheitssystemen betrachtet werden und nicht als einzige Quelle der Wahrheit. Es ist wichtig zu beachten, dass KI minderwertige Tools nicht in effektive umwandeln kann. Um ihr Potenzial zu maximieren, sollte KI in Tools integriert werden, die bereits eine robuste Grundlage und eine nachgewiesene Erfolgsbilanz aufweisen.

SAST und DAST Tools: Ihr Starter-Pack für Application Security Testing

Anwendungssicherheit war noch nie so komplex und so kritisch. KI hat die Codegenerierung mühelos gemacht, aber dieselbe Beschleunigung erfordert ein neues Maß an Wachsamkeit.

Man kann nicht einfach traditionelle SAST-Tools oder DAST-Tools verwenden. Man muss KI mit KI bekämpfen. Und man sollte den Kampf in der Cloud und zur Laufzeit fortsetzen.

Genau hier glänzt Aikido.

Über SAST- und DAST-Tools hinaus bietet Aikido eine Vielzahl von KI-gesteuerten Tools, vom Schwachstellenmanagement bis zur kontinuierlichen Compliance-Transparenz, die es Ihnen ermöglichen, Ihren Code, Ihre Cloud und Ihre Laufzeitumgebung zu sichern.

Um Ihr Wissen zu vertiefen, könnten Sie auch mögen:

- Top Code-Schwachstellen-Scanner – Vergleichen Sie umfassendere statische Analysetools über reine KI hinaus.

- Top DevSecOps-Tools – Entdecken Sie, wie SAST in einen modernen DevSecOps-Workflow passt.

- Top 7 ASPM-Tools – Verwalten und priorisieren Sie Ergebnisse von Ihrem SAST und anderen Scannern.