Bug Bounty war in letzter Zeit ein sehr heißes Thema.

Wir sehen, wie hochkarätige Programme offline gehen oder sich grundlegend ändern: Das IBB (eines der wichtigsten Programme für Open-Source-Projekte) pausiert die Einreichungen, curl stellt die Auszahlungen ein und Node.js streicht seine Bounty komplett. Das ist kein Rauschen, das ist ein Signal.

Ich wollte verstehen, wohin sich Bug Bounty tatsächlich entwickelt, also habe ich mich mit zwei der glaubwürdigsten Stimmen auf den entgegengesetzten Seiten dieser Diskussion zusammengesetzt:

- Daniel Stenberg, der Erfinder von curl, der die Realität eines Maintainers lebt und kürzlich Bug-Bounty-Zahlungen eingestellt hat

- Casey Ellis, der Gründer von Bugcrowd, einer der Personen, die das Modell mit etabliert haben.

Ich stellte fest, dass das Bug-Bounty-Modell an einem Scheideweg steht und wir uns inmitten eines großen Wandels befinden.

Warum Bug Bounty so gut funktionierte

Bevor wir uns damit befassen, wohin sich das Modell entwickelt, wollen wir einen Schritt zurücktreten und verstehen, warum es in den letzten zehn Jahren eine der effektivsten Ideen im Bereich Sicherheit war.

Alles basiert auf der Idee, das Internet versuchen zu lassen, Ihre Systeme zu knacken, bevor Angreifer es tun. Und es funktionierte, weil es Unternehmen eine Skalierung ermöglichte, die sie niemals durch eigene Einstellungen erreichen könnten.

Wie Casey es ausdrückte:

“Wenn Sie versuchen, einen globalen Pool von Angreifern mit jemandem, der von 9 bis 17 Uhr arbeitet, zu überlisten, stimmt die Rechnung nicht.“

Das ist die Magie von Bug Bounty. Anstatt sich auf eine Handvoll interner Mitarbeiter zu verlassen, greifen Sie auf einen globalen Pool unterschiedlicher Fähigkeiten, Perspektiven und Motivationen zurück – die alle Ihr System auf Weisen angreifen, an die Ihr internes Team einfach nicht gedacht hat. Und das ohne die erheblichen Gemeinkosten, die für die Einstellung spezialisierter Experten intern anfallen würden.

Deshalb wurde es zu einem fundamentalen Bestandteil moderner Sicherheitsprogramme.

Was sich jetzt verändert

Was sich ändert, ist nicht die Nachfrage nach Sicherheit, sondern die Wirtschaftlichkeit, wie Bug Bounty funktioniert.

KI hat das Gleichgewicht verändert, und das nicht zum Guten. Bugs zu finden ist jetzt günstiger denn je, Berichte zu schreiben ist noch einfacher, und das Einreichen ist praktisch reibungslos geworden. Währenddessen haben sich die Kosten für die Validierung dieser Berichte und die tatsächliche Behebung der Probleme überhaupt nicht geändert.

- Bugs finden → günstig

- Berichte schreiben → günstiger

- Berichte einreichen → praktisch kostenlos

- Validierung → immer noch teuer

- Behebung → sehr teuer

Wir sehen dies in der Praxis. Es gibt drei Arten von Berichteinreichern. Es gibt Unternehmen, die einen neuen Ansatz für legitime Berichte verwenden. Dies sind Berichte, die geschichtete KI-Ansätze nutzen, die die Stärken mehrerer KI-Modelle, Guardrails, Orchestrierung und Kontext kombinieren, wie zum Beispiel Aikidos eigene KI-Penetrationstests-Fähigkeiten. Dann gibt es Einzelpersonen, die ihre Forschung und Berichterstellung mit KI als Werkzeug erweitern. Und schließlich gibt es Einzelpersonen, die sich dank dieser KI-Modelle weiterbilden können, um Berichte zu erstellen, die technisch plausibel erscheinen, aber dennoch völlig falsch sind.

Daniel beschrieb es perfekt: überzeugenderer Mist ist schlimmer als offensichtlicher Mist.

Man kann es nicht schnell abtun, man muss es untersuchen, und man verschwendet echte Zeit damit, zu beweisen, dass es Unsinn ist.

In großem Maßstab fühlt sich dies nicht mehr wie ein hilfreiches externes Beitragsmodell an, sondern ähnelt eher einem Denial-of-Service-Angriff auf die für die Sicherheit Verantwortlichen.

Und die Auswirkungen sind verheerend:

- Die Internet Bug Bounty (IBB) hat neue Einreichungen pausiert, da KI das Entdeckungsvolumen dramatisch über das hinaus erhöht hat, was die Maintainer bewältigen können.

- Node.js verlor sein Bounty, als die Finanzierung wegfiel; Berichte kommen immer noch herein, aber Auszahlungen gibt es keine mehr.

- curl hat finanzielle Belohnungen eingestellt, nachdem es mit KI-generierten Berichten überflutet wurde

Ein altes Problem, verstärkt

Casey betonte, dass dies kein neues Problem ist, sondern ein altes, das lediglich massiv beschleunigt wurde.

„Wir machen dumme Dinge schneller und mit mehr Energie.“

Bug Bounties hatten schon immer das Problem, kein faires Spielfeld zu sein: Eine Person reicht einen Bericht ein, und eine andere muss ihn validieren. Das klingt auf dem Papier gleich, aber in der Praxis war es für eine Person schon immer schwierig, mit der Validierung Schritt zu halten, selbst bevor KI existierte. Jetzt ist es praktisch unmöglich.

Wir leben jetzt in einer Welt, in der jeder Dutzende von Berichten generieren, sie glaubwürdig erscheinen lassen und sofort einreichen kann. Auf der Empfängerseite haben sich die Einschränkungen jedoch nicht geändert. Es sind immer noch Menschen, die prüfen, priorisieren und Entscheidungen treffen.

Open Source spürt die Auswirkungen zuerst

Im Open-Source-Bereich zeigt sich dieser Druck zuerst, hauptsächlich weil er bereits an seinen Grenzen operierte. Die meisten Projekte werden von kleinen Teams, oft Freiwilligen, mit begrenzter Zeit und Ressourcen gepflegt, obwohl sie massive Teile des Internets stützen.

Fügt man finanzielle Anreize, globale Beteiligung und jetzt KI-generierte Einreichungen hinzu, wird das System überfordert.

Das IBB-Programm formulierte es direkt:

KI-gestützte Entdeckung hat das Gleichgewicht zwischen Funden und Behebungskapazität verschoben

Übersetzung:

Wir finden mehr Bugs, als wir bewältigen können.

Die Belohnung ist nun weg, doch die Erwartung der Meldung bleibt bestehen. Aber die Frage ist: Ist die Art und Weise, wie Bug-Bounty-Programme genutzt wurden, um Sicherheitsteams effektiv zu skalieren und die Sicherheitsposition zu verbessern, ohne finanzielle Anreize noch praktikabel?

Casey glaubt das nicht unbedingt:

Jede Organisation sollte ein Programm zur Offenlegung von Schwachstellen haben, denn wenn man im Internet ist, werden Leute Probleme finden. Aber nicht jede Organisation ist in der Lage, ein öffentliches, belohnungsbasiertes Bounty-Programm zu betreiben.

Seiner Meinung nach hätte curl wahrscheinlich von Anfang an keines haben sollen:

„Ich glaube nicht, dass jede Organisation [ein Bounty-Programm betreiben] sollte… das curl-Programm hätte von vornherein kein Bounty-Programm sein sollen.“

Doch Daniels Erfahrung zeigt etwas Nuancierteres. Daniel betrachtet das Bounty-Programm als Erfolg, weil es eine echte Überprüfung des Codes anregte:

„Ich habe es immer als Erfolg betrachtet, weil es eine großartige Möglichkeit ist, Menschen tatsächlich dazu zu ermutigen, den Code zu überprüfen…“

Was passiert, wenn man finanzielle Anreize entfernt

Man würde annehmen, dass man, wenn man finanzielle Anreize entfernt, KI-Müll loswird, aber auch die Wahrscheinlichkeit verringert, dass echte Schwachstellen offengelegt werden.

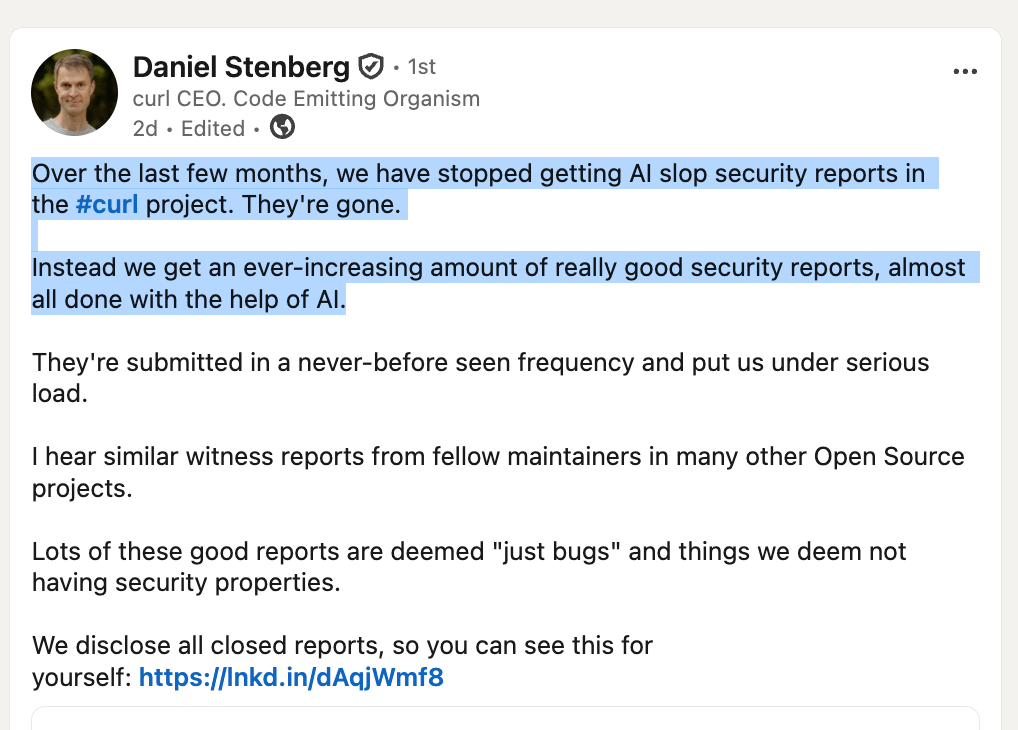

Doch als curl die finanziellen Anreize entfernte, geschah etwas Interessantes. Der minderwertige, KI-generierte Lärm verschwand weitgehend.

Daniel sagte: „Wir erhalten keine KI-Müll-Sicherheitsberichte mehr… Stattdessen erhalten wir eine ständig wachsende Menge an wirklich guten Sicherheitsberichten…, die in einer nie zuvor gesehenen Häufigkeit eingereicht werden und uns ernsthaft belasten.“

Anstatt in minderwertigen Berichten zu versinken, sehen sich Maintainer nun mit einer großen Anzahl wirklich nützlicher Ergebnisse konfrontiert, von denen viele durch KI-gestützte Forschung ermöglicht werden. Die Eintrittsbarriere ist gesunken, nicht nur für schlechte, sondern auch für gute Berichte.

Das erzeugt eine neue Art von Druck.

Selbst hochwertige Berichte erfordern Zeit zum Verstehen, Validieren und Beheben. Und viele dieser „guten“ Ergebnisse fallen immer noch in Grauzonen – Bugs, die möglicherweise nicht die Sicherheitsschwellenwerte erfüllen, aber dennoch Aufmerksamkeit erfordern. Das Ergebnis ist eine anhaltende und in gewisser Weise erhöhte Belastung für bereits ausgelastete Teams.

Auf seltsame Weise wurde das System also nicht entlastet. Es wurde verfeinert.

Das System aufbrechen, um es zu verbessern

Und hier wird es interessant. Denn obwohl dies kurzfristig eindeutig schmerzhaft ist, könnte es tatsächlich ein Schritt in die richtige Richtung sein.

Durch die Abschaffung finanzieller Anreize eliminieren wir einen Großteil des Rauschens. Was bleibt, ist ein Signal, das im Durchschnitt von höherer Qualität, zielgerichteter und besser auf tatsächliche Sicherheitsergebnisse abgestimmt ist.

Gleichzeitig senkt KI die Hürde für Forscher, sinnvolle Arbeit zu leisten. Sie ermöglicht es mehr Menschen, echte Probleme schneller als je zuvor zu finden. Diese Kombination – weniger Rauschen, mehr Signal, aber immer noch überwältigendes Volumen – deutet darauf hin, dass wir uns in einer Übergangsphase befinden.

Das aktuelle Modell bricht unter dem Druck zusammen. Doch was darunter entsteht, könnte besser sein.

Ein System, in dem:

- Offenlegung erwartet wird, nicht incentiviert

- Belohnungen gezielter sind, nicht breit gefächert

- und der Fokus sich von mehr Berichten zu besseren Ergebnissen verschiebt

Wir sind noch nicht so weit. Im Moment befinden wir uns in einer unübersichtlichen Übergangsphase, in der das alte Modell nicht mehr funktioniert und das neue noch nicht vollständig ausgeprägt ist.

Doch wenn sich dies richtig entwickelt, haben wir am Ende nicht weniger Bug Bounty.

Wir erhalten eine nachhaltigere Version davon.

Hacker verschwinden nicht

Eines der größten Missverständnisse dabei ist die Annahme, dass, wenn Bug Bounty in Schwierigkeiten gerät, Hacker irgendwie damit verschwinden.

So funktioniert das nie.

Hacker hören nicht auf, sie bewegen sich. Sie folgen Gelegenheiten, Komplexität und Wissenslücken. Wenn ein Bereich gesättigt ist, wechseln sie zu einem anderen, sei es APIs, Lieferketten oder zunehmend KI-Systeme und komplexe Logikfehler.

Wie Casey betonte, selbst wenn wir die heutigen Probleme lösen würden, würden Angreifer nicht einfach einpacken und nach Hause gehen. Es wird immer neue Technologien, neue Systeme und neue Fehler geben, die ausgenutzt werden können.

Solange Menschen Software entwickeln, wird es Schwachstellen geben.

Was bedeutet, dass der Bedarf an Personen, die sie finden, nicht verschwindet.

Allerdings wenden sich Bug Bounty Hunters von dieser Tätigkeit ab, teils wegen der Frustration im Umgang mit überforderten Triagern und teils wegen des Wegfalls finanzieller Anreize. Stattdessen wechseln sie in Beratungsrollen und interne Forschungspositionen.

Was als Nächstes passiert

Bug Bounty wird nicht verschwinden, aber es wird sich weiterentwickeln.

Wir bewegen uns wahrscheinlich auf ein Modell zu, bei dem die Offenlegung von Schwachstellen zu einer grundlegenden Erwartung in der gesamten Branche wird, anstatt etwas Optionales oder Anreizbasiertes zu sein. Öffentliche Bounty-Programme werden nicht verschwinden, aber sie werden kontrollierter, zielgerichteter und stärker an die organisatorische Reife angepasst.

Gleichzeitig wird KI unweigerlich eine größere Rolle beim Filtern und Triage des wachsenden Berichtsvolumens spielen. Sie wird das Problem nicht vollständig lösen, aber sie wird Teil unserer Managementstrategie werden.

Wir werden auch eine Verschiebung bei dem sehen, was tatsächlich belohnt wird. Da automatisierte Systeme immer besser darin werden, Low-Level-Probleme zu finden, wird der Wert dieser Erkenntnisse sinken. Stattdessen werden sich die Anreize auf Arbeiten mit höherer Auswirkung verlagern: die Art von Arbeit, die Kreativität, Kontext und ein tieferes Verständnis von Systemen erfordert.

Das bedeutet, dass Forschende sich zunehmend auf Bereiche wie das Verketten von Schwachstellen, das Ausnutzen von Geschäftslogik und das Aufbrechen komplexer oder neuer Technologien konzentrieren werden, bei denen die Automatisierung noch Schwierigkeiten hat.

Mit anderen Worten, die Messlatte wird höher gelegt, Forschende werden nicht verschwinden, aber die Belohnungen müssen gleichermaßen erweitert werden.